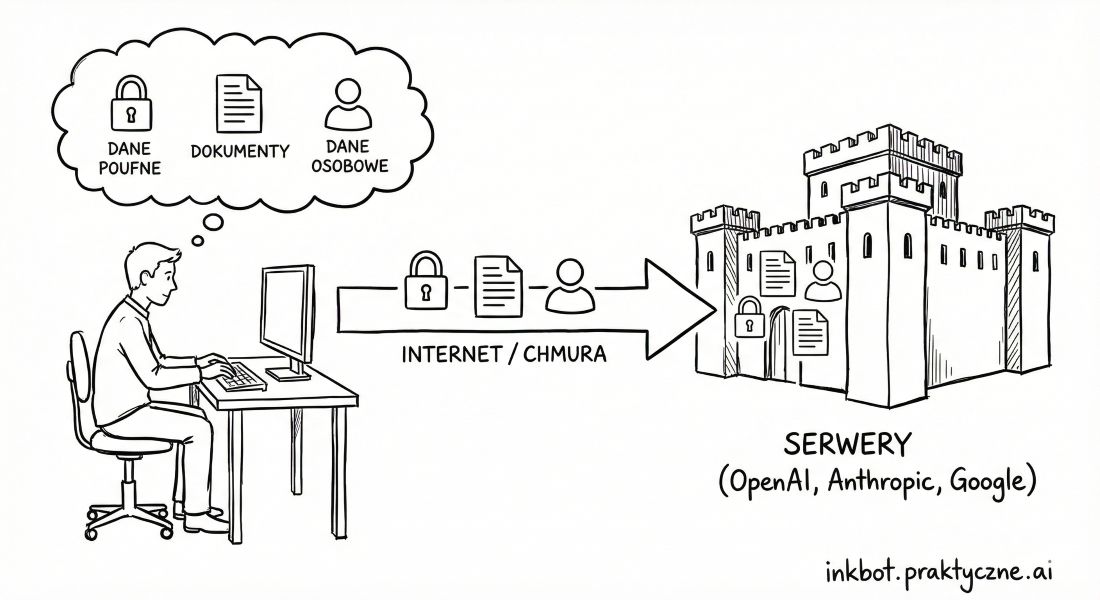

Twoje dane idą w chmurę

Każde słowo, które wpisujesz w chatbota, każdy dokument który wrzucasz - wszystko to wędruje na serwery firmy, która dostarcza usługę. ChatGPT? Serwery OpenAI. Claude? Serwery Anthropic. Gemini? Google.

To nie jest straszenie - to po prostu fakt, o którym warto pamiętać. ChatGPT nie działa na Twoim komputerze. Działa gdzieś w chmurze, a Ty tylko wysyłasz mu dane i odbierasz odpowiedzi.

Istnieją modele, które można zainstalować lokalnie (na własnym komputerze), ale na tym etapie nie będziemy się nimi zajmować.

Co to oznacza w praktyce?

Dane firmowe, poufne dokumenty, informacje o klientach, dane osobowe - wszystko to opuszcza twoją organizację w momencie wklejenia do okna czatu. Czy to bezpieczne? Zależy od polityki danej firmy, Twojej umowy z nimi, przepisów które Cię obowiązują, ale generalnie "nie bardzo". Znamy przypadki, że umowa umową, a życie pisze swoje scenariusze.

Czy twoje rozmowy trenują model?

To zależy od wersji i ustawień. W darmowych wersjach chatbotów Twoje rozmowy mogą być używane do dalszego treningu modeli (zazwyczaj domyślnie są). Oznacza to, że fragment Twojej rozmowy - teoretycznie - mógłby kiedyś "wypłynąć" w odpowiedzi dla kogoś innego. Ryzyko jest małe, ale niezerowe.

Jak to wygląda u głównych graczy:

ChatGPT darmowy - domyślnie rozmowy mogą być używane do treningu, ale można to wyłączyć w ustawieniach

ChatGPT płatny - w wersjach płatnych dane domyślnie nie są używane do treningu

Claude darmowy - Anthropic deklaruje, że nie używa rozmów do treningu, chyba że użytkownik wyrazi zgodę

Claude płatny - dane nie są używane do treningu

Gemini - polityka Google, warto sprawdzić aktualne ustawienia

Uwaga: polityki się zmieniają. To co napisałem wyżej, może być już nieaktualne. Zawsze sprawdzaj aktualne warunki usługi.

Na co zwrócić uwagę

1. Nie wrzucaj danych, których wyciek byłby katastrofą

Hasła, numery kart kredytowych, dane medyczne pacjentów, poufne umowy - tego po prostu nie wklejaj. Nawet jeśli firma deklaruje bezpieczeństwo, minimalizuj ryzyko.

2. Anonimizuj dane gdy to możliwe

Zamiast "Przygotuj mail do Jana Kowalskiego z firmy ABC o numerze NIP 123-456-78-90" napisz "Przygotuj mail do klienta w sprawie opóźnionej płatności". Dodasz szczegóły sam, po otrzymaniu szkicu.

3. Sprawdź ustawienia prywatności

Większość chatbotów ma opcję wyłączenia używania rozmów do treningu. Znajdź ją i włącz, jeśli zależy Ci na prywatności.

4. Rozważ wersję płatną dla zastosowań firmowych

Wersje biznesowe oferują lepsze gwarancje bezpieczeństwa, umowy o przetwarzanie danych i zgodność z regulacjami typu RODO. Jeśli używasz AI w pracy z danymi klientów to nie jest miejsce na oszczędności.

5. Pamiętaj o przepisach

Jeśli pracujesz z danymi osobowymi w UE, obowiązuje Cię RODO. Wysyłanie danych osobowych do amerykańskiego serwera może być problematyczne prawnie. Skonsultuj to z działem prawnym, zanim zaczniesz używać AI na danych klientów.

Lokalne modele - alternatywa dla "paranoików"

Istnieją modele, które możesz uruchomić na własnym komputerze - wtedy dane nigdzie nie wędrują. Llama, Mistral, czy polskie modele jak Bielik. Są słabsze (do ogólnych zadań) od ChatGPT czy Claude'a, ale dla niektórych zastosowań wystarczą.

To temat na osobny rozdział, ale warto wiedzieć, że taka opcja istnieje. Jeśli pracujesz z naprawdę wrażliwymi danymi i nie możesz ich wysyłać w chmurę - lokalne modele mogą być rozwiązaniem.

W czym AI jest naprawdę dobre

Zacznijmy od pozytywów. Są zadania, w których chatboty są niesamowicie skuteczne:

Przetwarzanie tekstu

Streszczanie, parafrazowanie, tłumaczenie, zmiana stylu, korekta. Dajesz modelowi tekst, mówisz co z nim zrobić - robi. Szybko, sprawnie, bez marudzenia. Masz 20-stronicowy raport, a potrzebujesz podsumowania na jedną stronę? Mniej niż minutę roboty.

Generowanie treści

Maile, posty, opisy produktów, szkice artykułów. Model świetnie radzi sobie z zadaniami typu "napisz coś w stylu X na temat Y". Nie zawsze trafiony w punkt, ale jako punkt wyjścia - bezcenne. Super eliminują problem "czystej kartki", nie zaczynasz od zera.

Wyjaśnianie i tłumaczenie pojęć

Zapytaj chatbota o wyjaśnienie czym jest inflacja, jak działa kredyt hipoteczny albo o co chodzi w mechanice kwantowej. Dostaniesz wyjaśnienie dostosowane do poziomu, o który poprosisz - od "wytłumacz jak 5-latkowi" po "wyjaśnij jak studentowi ekonomii".

Burza mózgów

Potrzebujesz pomysłów? Model wygeneruje ich tuzin w kilka sekund. Nie wszystkie będą genialne, ale przełamią blokadę twórczą i dadzą punkt zaczepienia. Mogą być też inspirujące i stymulujące do własnych pomysłów.

Praca z ustrukturyzowanymi danymi

Masz listę, tabelę, zbiór danych? Model pomoże posortować, przekształcić, wyciągnąć wzorce. Nie zastąpi Excela w obliczeniach, ale jakoś sobie poradzi z interpretacją i reorganizacją.

Programowanie i praca z kodem

Nawet jeśli nie jesteś programistą, chatbot może pisać skrypty, wyjaśniać kod, znajdować błędy, a nawet tworzyć całe aplikacje. Dla programistów to asystent, który wspomaga pracę.

W czym AI jest naprawdę słabe

A teraz ciemna strona. Są rzeczy, przy których chatbotom nie należy ufać:

Fakty i liczby

Model nie sprawdza faktów - generuje tekst, który brzmi jak fakty. Zapytaj o datę urodzenia mało znanej osoby, a możesz dostać zmyśloną odpowiedź podaną z pełnym przekonaniem. Zapytaj ile to 17,3% z 847 293 - może policzyć źle, bo nie liczy, tylko zgaduje.

Aktualne informacje

Bez dostępu do internetu model nie wie co wydarzyło się po jego treningu. Ale nawet z dostępem może wybrać nieaktualne źródło albo źle zinterpretować wyniki.

Wąskie specjalizacje

Im bardziej niszowy temat, tym większe ryzyko błędu. Model dużo wie o popularnych dziedzinach, ale w wąskich specjalizacjach - prawo podatkowe w konkretnym kraju, rzadkie choroby, lokalne przepisy - może generować pozornie sensowny bełkot.

Logika i rozumowanie wieloetapowe

Proste wnioskowanie? OK. Złożony łańcuch zależności, gdzie jeden błąd psuje wszystko? Ryzykowne. Model nie "myśli" krok po kroku - generuje tekst, który wygląda jak myślenie krok po kroku.

Liczenie i matematyka

Model językowy to nie kalkulator. Proste działania zwykle wychodzą, ale przy bardziej skomplikowanych obliczeniach potrafi się pomylić. Dlatego nowoczesne chatboty mają dodatkowe narzędzia - uruchamiają w tle prawdziwy kod, który liczy.

Halucynacje - gdy AI kłamie z kamienną twarzą

Halucynacja to termin na sytuację, gdy model generuje informację, która brzmi wiarygodnie, ale jest całkowicie zmyślona.

Klasyczny przykład: prosisz o bibliografię do artykułu naukowego. Dostajesz listę publikacji: autorzy, tytuły, czasopisma, numery stron. Wszystko wygląda profesjonalnie. Sprawdzasz, a tu połowa tych publikacji nie istnieje. Autorzy są prawdziwi, tytuły brzmią sensownie, ale takie artykuły nigdy nie powstały.

Dlaczego tak się dzieje? Wracamy do fundamentów: model nie wie co jest prawdą. Wie co jest prawdopodobne. Widział tysiące bibliografii i nauczył się jak wyglądają. Generuje tekst pasujący do wzorca "bibliografia" ale niekoniecznie tekst zgodny z rzeczywistością.

Jak rozpoznać halucynację?

Niestety nie da się jej rozpoznać po samej odpowiedzi. Halucynacja wygląda identycznie jak prawda. Model nie sygnalizuje niepewności, nie dodaje "ale nie jestem pewien". Mówi z tym samym przekonaniem, czy podaje fakt, czy zmyśla.

Jedyny sposób: weryfikacja zewnętrzna. Sprawdzenie w wyszukiwarce. Zapytanie innego źródła. Użycie zdrowego rozsądku.

Pewność siebie to nie pewność informacji

To pułapka, w którą wpadają wszyscy na początku. Chatbot odpowiada pewnie, więc zakładamy, że wie co mówi.

Ale model nie ma "poziomu pewności" w ludzkim sensie. Nie czuje, że czegoś nie wie. Generuje tekst słowo po słowie, wybierając najbardziej prawdopodobne kontynuacje. Że wynik jest poprawny? Szczęśliwy zbieg okoliczności. Że jest błędny? Pechowy zbieg okoliczności. Dla modelu oba scenariusze wyglądają tak samo.

Czasem model powie "nie jestem pewien" albo "nie mam informacji na ten temat". Ale to nie znaczy, że w innych przypadkach jest pewien. To znaczy, że wzorce treningowe sugerują, że w tym miejscu ludzie zwykle wyrażali niepewność.

Efekt papugi

Przypomnij sobie papugę z biblioteki z pierwszego rozdziału. Papuga naśladuje mowę, nie rozumiejąc znaczenia. Chatbot robi to samo, tylko na znacznie bardziej wyrafinowanym poziomie.

Pyta Cię o radę? Nie dlatego, że chce pomóc. Widział tysiące rozmów, w których ludzie zadawali pytania doprecyzowujące. Przeprasza za błąd? Nie dlatego, że czuje się źle. Wzorce treningowe mówią, że po informacji o błędzie następuje przeproszenie.

To nie znaczy, że odpowiedzi są bezwartościowe. Są bardzo wartościowe. Ale trzeba pamiętać, że za nimi nie stoi rozumienie lecz stoi dopasowanie do wzorca.

Praktyczne zasady bezpieczeństwa

Kilka reguł, które pozwolą ci korzystać z AI bez wpadania w pułapki:

1. Ufaj w generowaniu, weryfikuj w faktach

Model napisze ci świetnego maila, ale jeśli w mailu ma być data spotkania czy kwota z umowy to sprawdź sam.

2. Im bardziej specyficzne, tym większe ryzyko

"Wyjaśnij czym jest inflacja" - bezpieczne. "Jaka była inflacja w Rumunii w marcu 2019 według metodologii Eurostatu" - sprawdź.

3. Konsekwencje błędu jako filtr

Szkic posta na social media? Jeśli model się pomyli, poprawisz. Informacja do umowy prawnej? Nie ryzykuj.

4. Proś o źródła, potem je sprawdzaj

Możesz poprosić model o podanie źródeł. Da ci je. Ale potem sprawdź, czy istnieją bo mogą być halucynacją.

5. Używaj wielu źródeł

Nie polegaj na jednym chatbocie. Zapytaj drugiego. Sprawdź w Google. Triangulacja zmniejsza ryzyko.

Podsumowanie

AI świetnie przetwarza tekst, generuje treści, wyjaśnia pojęcia, pomaga w burzy mózgów.

AI słabo weryfikuje fakty, liczy (chociaż to się zmienia), zna aktualne informacje i wąskie specjalizacje.

Halucynacje to zmyślone informacje podane z pełnym przekonaniem.

Pewność w głosie chatbota nie oznacza pewności informacji.

Zasada: ufaj w generowaniu, weryfikuj w faktach.

Im większe konsekwencje błędu, tym dokładniej sprawdzaj.