Wyobraź sobie, że dzwonisz na infolinię. Tłumaczysz problem przez dziesięć minut. Konsultant mówi "proszę czekać" i przełącza Cię do innego działu. Nowy konsultant pyta: "W czym mogę pomóc?". Zaczynasz od nowa. Znasz to uczucie?

To wbrew pozorom jeden z ważniejszych rozdziałów w tym kursie. Bo większość frustracji z AI nie wynika z tego poczucia po stronie użytkownika, że narzędzie jest "głupie". Wynika z tego, że ludzie nie rozumieją, jak działa jego pamięć. A raczej jak bardzo jej nie ma.

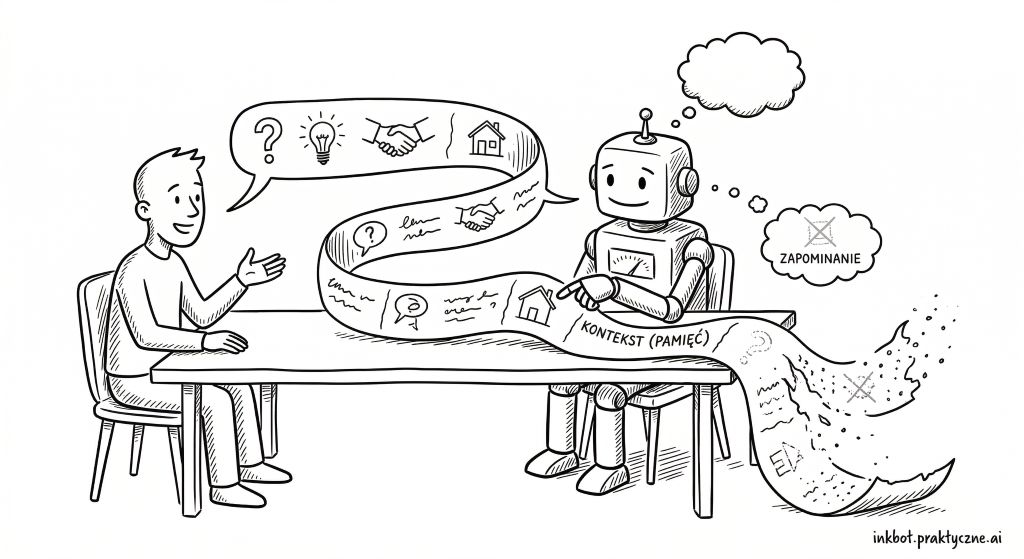

Kiedy piszesz z kimś na czacie, zakładasz, że rozmówca pamięta o czym gadaliście pięć minut temu. Z człowiekiem to działa. Z chatbotem - na pozór też, ale mechanizm pod spodem jest zupełnie inny. I kiedy ten mechanizm zawiedzie (a zawiedzie), dobrze jest wiedzieć dlaczego.

Okno kontekstu, czyli ile AI mieści w swojej pamięci

Każdy chatbot ma coś, co fachowo nazywa się "oknem kontekstu" (context window). To taka pamięć krótkotrwała - ilość tekstu, którą AI (a dokładnie LLM) potrafi jednocześnie od nas otrzymać i brać pod uwagę.

Porównaj to do biurka. Masz biurko określonej wielkości. Możesz na nim rozłożyć dokumenty, notatki, wydruki. Dopóki się mieszczą - widzisz wszystko i możesz się do tego odwołać. Ale kiedy biurko się zapełni, musisz zdjąć najstarsze dokumenty, żeby położyć nowe. Te zdjęte? Przepadły. AI nie pamięta, że tam były. A co z szufladami? Można na chwilę schować część dokumentów, a później po nie sięgnąć? To nie takie proste, dlatego na tym etapie uznajmy, że literalnie mówiąc o oknie kontekstowym to nie. Mamy biurko o określonej powierzchni i tyle.

Ile mieści się na tym biurku? Zależy od modelu.

Najpotężniejsze modele (GPT-5.4, Gemini 3, Claude Opus 4.6) mają okna kontekstowe o wielkości około miliona tokenów. Biorąc pod uwagę, że tak lubiany niegdyś model gpt-4o miał "zaledwie" 128 tysięcy tokenów to ta "bańka" brzmi nieźle.

Uwaga! To, że model ma milionowe okno kontekstowe nie znaczy, że zawsze będzie lepszy od tego z mniejszym oknem. Wszystko zależy od zastosowania. Do niektórych zadań mniejsze modele będą lepsze (np. szybciej wykonają zadanie na wystarczającym poziomie skuteczności).

Wracając do tego miliona. Brzmi jak dużo? Jest pewien haczyk.

Po pierwsze - "tokeny" to nie słowa. Token to kawałek tekstu, który model traktuje jako jednostkę. Czasem to całe słowo, czasem jego fragment, np. 4 znaki. Jedno polskie słowo to zazwyczaj 2-3 tokeny (angielskie słowa są często "tańsze"). Słowo "wykorzystywanie" to dla modelu pewnie 3-4 tokeny. Słowo "AI" - jeden.

Po drugie - na to biurko musi się zmieścić nie tylko to, co Ty piszesz. Leży tam też wszystko, co AI Ci odpowiada (a chatboty lubią pisać dużo), wewnętrzne instrukcje systemu, których nie widzisz, załączone pliki i cała historia Waszej rozmowy od pierwszego zdania. Czyli każda odpowiedź chata jest drukowana na dodatkową kartkę i ląduje na blacie biurka.

Po trzecie - i to jest najważniejsze - im więcej tekstu w oknie kontekstu, tym gorzej AI sobie z nim radzi. Badania pokazują, że modele zaczynają tracić precyzję, gdy okno kontekstu zapełni się w 60-70%. Taki model z oknem na 200 000 tokenów realnie dobrze działa do mniej więcej 130 000. Dalej jest coraz gorzej, ale nie stopniowo - raczej skokowo. W pewnym momencie AI po prostu zaczyna "gubić" informacje.

Przy intensywnej sesji to biurko zapełnia się szybciej niż myślisz. Godzina aktywnej rozmowy z dłuższymi odpowiedziami? Kilkadziesiąt tysięcy tokenów poszło.

Co AI widzi, kiedy z Tobą rozmawia

Kiedy otwierasz czat i piszesz pierwsze pytanie, chatbot dostaje mniej więcej taki pakiet informacji:

- Instrukcje systemowe - zasady zachowania, których nie piszesz bezpośrednio, ale na przykład mogłeś je skonfigurować wcześniej.

- Twoje pytanie.

- Jego odpowiedź.

- Twoje kolejne pytanie.

- Jego kolejna odpowiedź.

- I tak dalej...

Cała ta wymiana leci na jedno biurko. Każda Twoja wiadomość i każda odpowiedź AI zajmują miejsce. AI nie "pamięta" waszej rozmowy tak jak Ty pamiętasz wczorajszą pogawędkę przy kawie. Ono po prostu za każdym razem czyta całą rozmowę od nowa i na tej podstawie generuje odpowiedź.

To kluczowa rzecz do zrozumienia, więc powtórzę: chatbot nie ma pamięci w ludzkim sensie. Kiedy piszesz mu trzecią wiadomość, on nie "pamięta" dwóch poprzednich. On dostaje cały dotychczasowy zapis rozmowy i czyta go od początku. Za każdym razem. Od pierwszego słowa. Czyli tak jakby Cię przełączyli do kolejnego człowieka na infolinii, a on chwilę przed powiedzeniem "dzień dobry, w czym mogę pomóc" usłyszał o czym rozmawiałeś wcześniej od osoby przełączającej rozmowę.

To jak kelner, który nie pamięta Twojego zamówienia, ale ma przed sobą kartkę z notatkami. Dopóki kartka jest na stole - wie, że prosiłeś o schabowego bez kapusty. Zabierz kartkę i patrzy na Ciebie jak na nowego klienta.

Dlatego chatbot potrafi nawiązywać do wcześniejszych fragmentów rozmowy. Nie dlatego, że je pamięta. Dlatego, że je czyta. Różnica subtelna, ale praktycznie ogromna bo oznacza, że "pamięć" AI jest ograniczona rozmiarem tego zapisu.

Kiedy AI zaczyna zapominać

Są trzy sytuacje, w których chatbot "traci pamięć". Warto je znać, bo każda wymaga innego podejścia.

Sytuacja 1: Nowy czat = czysta kartka

To najprostszy przypadek. Zamykasz rozmowę, otwierasz nową - AI nie ma pojęcia, o czym gadaliście wcześniej. Dla niego każdy nowy czat to jak pierwszy dzień w nowej pracy. Nie wie, jak masz na imię, czym się zajmujesz, ani że godzinę temu tłumaczyłeś mu swój projekt przez dwadzieścia wiadomości.

Ludzie regularnie się na tym wykładają. Pracują z AI nad jakimś tekstem, zamykają czat, następnego dnia otwierają nowy i piszą: "Popraw ten tekst, o którym wczoraj rozmawialiśmy". AI grzecznie odpowiada, ale pojęcia nie ma, o jaki tekst chodzi. Bo nie ma tego tekstu. Nie ma wczoraj. Nie ma kontekstu.

Wyobraź sobie, że przychodzisz do fryzjera i mówisz "tak samo jak ostatnio". Tyle że to inny fryzjer, w innym salonie, i nigdy wcześniej Cię nie widział. Musisz opisać od nowa.

Rozwiązanie jest proste: gdy wracasz do tematu w nowym czacie, wklej najważniejsze ustalenia z poprzedniej rozmowy. Nie musisz kopiować całej historii - wystarczy streszczenie w 3-5 zdaniach. "Pracujemy nad artykułem o wpływie AI na branżę HR. Ustalony ton: profesjonalny ale nie suchy. Grupa docelowa: dyrektorzy HR w firmach 200+ osób. Struktura: 5 sekcji, każda 300 słów." To wystarczy, żeby AI wskoczyło z powrotem w temat. Możesz dodać też ewentualny wynik poprzedniej rozmowy - jeżeli akurat Ci się podobał.

No i oczywiście możesz też kontynuować poprzedni czat korzystając z okna z historią czatów.

Sytuacja 2: Za długa rozmowa

Pamiętasz to biurko? Po kilkudziesięciu wymianach zdań w jednym czacie, biurko się zapełnia. AI zaczyna "zapominać" to, co było na początku rozmowy. Nie robi tego z premedytacją - po prostu najstarsze fragmenty wypadają z okna kontekstu.

W praktyce wygląda to tak: przez pierwszą godzinę chatbot pamięta, że piszecie artykuł o marketingu dla firm budowlanych, że ma być w tonie eksperckim, i że grupa docelowa to właściciele małych firm remontowych. Po dwóch godzinach intensywnej wymiany zdań - pytania, poprawki, nowe wersje, dygresje - nagle zaczyna pisać generycznie, jakby zapomniał, dla kogo ten tekst jest. Bo zapomniał. Te ustalenia z początku rozmowy już spadły z biurka.

Rozpoznasz to po objawach: AI zaczyna powtarzać pytania, które już omawialiście. Zmienia styl, choć go nie prosiłeś. Ignoruje ograniczenia, które ustaliliście wcześniej. Albo nagle robi coś dziwnego i odpowiada w suahilli, choć cała rozmowa była po polsku.

Jeśli kiedyś poczujesz, że AI "zgłupiało" w trakcie dłuższej rozmowy - prawdopodobnie właśnie przekroczyliście pojemność okna kontekstu. Nie wściekaj się na narzędzie. Po prostu zacznij nowy czat i podaj kluczowe ustalenia jeszcze raz.

Sytuacja 3: AI ignoruje środek rozmowy

To jest podstępne i mało kto o tym wie. Badania pokazują, że chatboty mają tendencję do lepszego "pamiętania" początku i końca rozmowy, a gorzej radzą sobie ze środkiem. Naukowcy nazywają to efektem "zagubienia w środku" (lost in the middle).

To trochę jak z długim mailem od szefa. Pamiętasz pierwsze zdanie i ostatnie. Środek? Rozmywa się. AI działa podobnie. Jeśli ważne ustalenie padło gdzieś w wiadomości numer 15 z 40, jest spora szansa, że chatbot je przeoczy - nawet jeśli technicznie mieści się w oknie kontekstu.

Co z tym zrobić? Jeśli coś jest naprawdę ważne - powtórz to w późniejszej wiadomości. Albo przenieś kluczowe ustalenia na początek nowego czatu, gdzie AI poświęci im najwięcej uwagi.

Pamięć długoterminowa - chatbot, który Cię "zna"

Do tej pory mówiliśmy o pamięci w ramach jednego czatu. Ale ChatGPT, Claude i Gemini mają też mechanizmy pamięci długoterminowej - takie, które działają pomiędzy rozmowami.

ChatGPT ma funkcję "Memory" (Pamięć). Działa na dwa sposoby. Po pierwsze, możesz mu powiedzieć "zapamiętaj, że jestem wegetarianinem" i zapamięta to na przyszłość. Po drugie, sam wyłapuje pewne informacje z rozmów i zapisuje je sobie. Następnym razem, gdy zapytasz o przepis na obiad, nie zaproponuje Ci schabowego.

Claude (Anthropic) ma podobny system - zbiera informacje z poprzednich rozmów i wykorzystuje je w kolejnych. Możesz też ręcznie zarządzać tym, co pamięta. Moim skromnym zdaniem działa najlepiej na ten moment.

Gemini (Google) również buduje profil użytkownika na podstawie rozmów.

Brzmi wygodnie? Jest. Ale jest też kilka rzeczy, które warto wiedzieć:

- Ta pamięć to nie jest pełna kopia Waszych rozmów. To raczej "notatki na karteczce" - krótkie streszczenia i fakty. Chatbot nie pamięta dokładnie, co mu powiedziałeś trzy tygodnie temu. Pamięta, że jesteś programistą, masz dwójkę dzieci i wolisz krótsze odpowiedzi. To jak kolega z pracy, który wie, że pijesz kawę z mlekiem, ale nie pamięta o czym gadaliście w zeszłym tygodniu przy ekspresie.

- Możesz zarządzać tą pamięcią. Sprawdź w ustawieniach, co chatbot o Tobie zapisał. W ChatGPT wejdź w Ustawienia → Personalizacja → Pamięć - zarządzaj. W Claude kliknij swój profil > Settings > Capabilities > Memory. Bywa zabawnie - ludzie odkrywają, że AI zapamiętało jakiś żart z przypadkowej rozmowy i traktuje go jako fakt o ich osobie. Taka pamięć jest aktualizowana co jakiś czas automatycznie.

- Jeśli pracujesz z poufnymi danymi firmowymi - przemyśl, czy chcesz, żeby chatbot zapamiętywał szczegóły Twoich projektów. W rozdziale o bezpieczeństwie wrócimy do tego tematu szerzej, ale nadal przypominam - nie wrzucaj danych osobowych i innych rzeczy, których nie chciałbyś by zostały kiedykolwiek ujawnione.

Ciekawostka! Sprawdź co czatbot o Tobie pamięta. Napisz prompt w nowym oknie czatu:

Na podstawie dotychczasowych konwersacji ze mną i wiedzy jaką zdobyłeś napisz roast o mojej osobie. Bądź bezpośrednim komikiem specjalizującym się w roastach.

I jak? :)

Jak z tym żyć - praktyczne zasady

Skoro wiesz, jak działa (i nie działa) pamięć AI, oto kilka zasad, które oszczędzą Ci frustracji:

1. Na początku rozmowy podaj kontekst.

Nie licz na to, że AI "się domyśli". Zamiast pisać "napisz mi maila do klienta", napisz "jestem kierownikiem projektu IT, piszę do klienta który jest dyrektorem finansowym w firmie produkcyjnej, chcę przypomnieć o zaległej fakturze za 15 000 zł, ton ma być stanowczy ale uprzejmy". Te dodatkowe 20 sekund pisania zaoszczędzą ci 10 minut poprawek.

To jest chyba najważniejsza rada w tym kursie: kontekst to paliwo dla AI. Bez kontekstu chatbot jest jak taksówkarz, któremu powiedziałeś "jedź". Dokądś dojedzie, ale raczej nie tam, gdzie chciałeś.

2. Długie projekty dziel na osobne czaty.

Nie ciągnij jednej rozmowy przez cztery godziny. Lepiej podziel pracę na etapy. Jeden czat na research, drugi na pisanie, trzeci na redakcję. Na początku każdego nowego czatu podaj kluczowe ustalenia z poprzedniego - skondensowane do kilku zdań.

Sprawdzi się prosta technika: pod koniec rozmowy poproś AI "podsumuj nasze ustalenia w 5 punktach, tak żebym mógł wkleić to na początek nowego czatu". Dostajesz gotową "ściągawkę", którą wklejasz w nowy czat - i AI od razu wie, o czym gadacie.

3. Podsumowuj co jakiś czas.

Jeśli rozmowa się rozciąga, napisz co kilkanaście wiadomości: "Podsumujmy gdzie jesteśmy - pracujemy nad X, ustaliliśmy Y, następny krok to Z". To działa jak odświeżenie notatek na biurku. AI lepiej utrzyma wątek. Możesz podsumowanie przekleić do nowego czatu i w ten sposó zresetować okno kontekstowe.

4. Ważne ustalenia powtarzaj.

Jeśli na początku rozmowy ustaliłeś, że tekst ma być w stylu formalnym i nie dłuższy niż 500 słów - przypomnij to, gdy prosisz o kolejną wersję jeżeli widzisz, że przestaje się tego trzymać.

5. Ale u innych to działa lepiej.

Widziałeś, że koleżanka zaczyna nowy czat, nie przedstawia się, a chatbot wie gdzie koleżanka pracuje i co będą właśnie generować? Przecież to się nie zgadza z tym co przed chwilą przez tyle minut czytałeś? Powyższe to podstawowa zasada jak działają LLM'y. Natomiast nowoczesne czatboty mają dodatkowe mechanizmy. Jednym z takich mechanizmów są "projekty" i instrukcje systemowe.

ChatGPT ma "Custom Instructions" (Instrukcje niestandardowe) i "Projects" (Projekty). Claude ma "Projects" z możliwością dodawania dokumentów i instrukcji. Gemini ma "Gems". To sposób na podanie kontekstu, który będzie dostępny w każdej rozmowie - bez potrzeby powtarzania za każdym razem.

Wyobraź sobie, że zamiast za każdym razem tłumaczyć AI kim jesteś i jak chcesz żeby pisało, raz konfigurujesz "profil" i od tego momentu każdy nowy czat zaczyna się z tym kontekstem już na biurku. Wrócimy do tego szczegółowo w innym module, ale warto wiedzieć, że takie narzędzia istnieją. Osobiście korzystam z niego w kilku wersjach codziennie - to będzie kolejny "game changer" dla Ciebie.

Jak różne chatboty radzą sobie z przepełnieniem

Nie wszystkie chatboty reagują tak samo, gdy rozmowa robi się za długa. Warto wiedzieć, czego się spodziewać.

ChatGPT potrafi zgubić kontekst dość nagle. Przez dwadzieścia wiadomości trzyma wątek bez problemu, a potem - bęc - nagle odpowiada jakby nie czytał pierwszej połowy rozmowy. Mało ostrzeżeń, dużo zaskoczenia.

Claude radzi sobie z tym nieco łagodniej. Zamiast nagle zapominać, zaczyna sam sobie streszczać wcześniejsze fragmenty rozmowy i odzyskuje w ten sposób okno kontekstowe. Tracisz szczegóły, ale ogólny kierunek zostaje. To jak notatki, które ktoś skondensował z trzech stron do trzech zdań - wiesz o czym było, ale detale się rozmyły.

Gemini też się potrafi zgubić. Do niedawna miał największe okno kontekstowe.

Żaden chatbot nie powie Ci wprost "hej, zapomniałem o czym gadaliśmy dwadzieścia minut temu". To twoja robota, żeby to zauważyć. Dlatego te pięć zasad z poprzedniej sekcji nie jest opcjonalnych. To higiena pracy z AI. Natomiast też nie martw się na zapas - do wielu zastosowań wystarczy po prostu rozmawiać.

Tymczasowe czaty - kiedy nie chcesz być pamiętany

Każdy z głównych chatbotów oferuje tryb rozmowy, w której nic nie jest zapamiętywane. W ChatGPT to "Temporary Chat" (Tymczasowy czat), w Claude - "Incognito". W obydwu przypadkach ikonka w prawym górnym rogu ekranu. To przydatne w kilku sytuacjach: gdy pracujesz z wrażliwymi danymi firmowymi, testujesz coś eksperymentalnego, albo po prostu nie chcesz, żeby chatbot budował Twój profil na podstawie jednorazowego pytania. Ewentualnie jeżeli współdzielisz z kimś konto i wstydzisz się swojej historii czatu.

Traktuj to jak tryb incognito w przeglądarce. Rozmowa się odbywa, ale nie zostawia śladów. Chatbot nie zapisze z niej żadnych wspomień, nie doda nic do twojego profilu i nie uwzględni jej w przyszłych rozmowach. Co nie oznacza, że nie leci do chmury. Nadal jest wysyłana na serwery, więc bez numerów kart kredytowych, danych osobowych i zaginionych fragmentów z afery Watergate.

Podsumowanie

Pamięć AI to nie jest pamięć ludzka. To zestaw mechanizmów, z których każdy ma swoje ograniczenia:

- W ramach czatu - AI czyta całą rozmowę od nowa przy każdej wiadomości. Dopóki się mieści w oknie kontekstu, wszystko gra. Jak się nie mieści - fragmenty znikają.

- Między czatami - pamięć długoterminowa istnieje, ale jest powierzchowna. To notatki na karteczce, nie pełny zapis rozmów.

- Nowy czat - zawsze czysta kartka. Chcesz kontynuować temat? Podaj kontekst od nowa.

Im lepiej rozumiesz te ograniczenia, tym lepsze wyniki dostajesz. Nie dlatego, że AI staje się mądrzejsze. Dlatego, że Ty mądrzej z niego korzystasz. A to różnica jak między kierowcą, który wie gdzie jest sprzęgło, a takim, który wsiada i ma nadzieję, że samochód sam się domyśli.

Co dalej?

To był ostatni rozdział Modułu 1. Wiesz już czym są chatboty, który do czego, jak wygląda interfejs, jak przeprowadzić pierwszą rozmowę i jak działa pamięć AI. Masz fundamenty. Czas zacząć budować.

W Module 2: Sztuka zadawania pytań przejdziemy do konkretów. Nauczysz się budować pytania, które dają sensowne odpowiedzi za pierwszym razem. Poznasz strukturę dobrego promptu, techniki iteracji i dostaniesz gotowe szablony do codziennej pracy.

Bo chatbot jest dokładnie tak dobry, jak pytanie które mu zadasz. A większość ludzi zadaje pytania jak trzylatkowie w sklepie z zabawkami - "chcę to!" - i dziwi się, że wynik nie zachwyca.

Moduł 2 to zmieni.